Desxifrem pam a pam la Intel·ligència Artificial

Ja quasi tothom hem sentit parlar (i fins i tot hi hem “conversat”) del xatbot ChatGPT, una eina que respon a tot allò que li demanem per escrit: redacta qualsevol mena de text, resumeix o desenvolupa qualsevol idea o argument, i fins i tot és capaç de programar.

I tot plegat ho fa d’una forma quasi indistingible de com ho faria un ésser humà.

Potser també us sona el nom dels programaris DALL·E 2 o Midjourney, dues IA que, amb indicacions per escrit, creen imatges, fotografies i dibuixos molt versemblants.

I n’hi ha moltes més, especialitzades en altres temes, com el disseny, la música o l’educació.

Aquestes eines són el que s’anomena “Intel·ligència Artificial Generativa”, ja que són capaces de generar continguts nous.

La IA generativa té grans aplicacions, totes elles amb un potencial enorme per a l’espècie humana.

Posats a somniar, potser arribarà el dia en què aquest tipus d’IA ens permeti deixar de treballar i dedicar-nos al que més ens agrada.

És molt utòpic pensar que estem més a prop que mai de la vertadera societat del benestar?

Cert, un petit reducte de pensadors i tecnòlegs està generant un alarmisme injustificat. Diuen que la IA amaga certs perills. Que no és innòcua.

Segurament aquests “experts” serien els mateixos que a l’època de la Revolució Industrial advertien sobre els perills dels telers mecànics. I és que reconeguem-ho, no té sentit posar-li portes al camp.

Si creus que tot el que acabes de llegir és cert, enhorabona, has assimilat el relat imperant sobre la IA.

Potser t’aniria bé continuar llegint l’article…

El relat mediàtic: com es parla de la IA

L’impacte en la nostra percepció de la tecnologia “intel·ligent” està influït per com rebem la informació sobre aquest tema. I la manera com es construeix aquest relat informatiu, no està exempt dels interessos comercials de les grans empreses que produeixen i distribueixen aquesta tecnologia.

A l’estudi de Mediacat Com s’informa sobre intel·ligència artificial?, Bru Aguiló y Paul Zalduendo conclouen que als mitjans se’n parla de manera transversal, i no només en les seccions de tecnologia. I que sobretot, es fan notícies sobre la indústria de la IA, i no pas amb un enfocament de drets humans.

A més, les fonts són sovint les mateixes empreses que la fabriquen i comercialitzen, i poques vegades es posa el focus en els riscos o en la falta de regulació, sinó que es posa l’accent en els seus beneficis.

Tinguem present, doncs, que l’impacte i el soroll mediàtic no s’adeqüen a la realitat.

D’una banda, perquè no és quelcom tan nou: la intel·ligència artificial ja era a les nostres vides molt abans de tot aquest rebombori.

I, per altra banda, si bé la intel·ligència artificial millora l’eficiència i la productivitat en tasques complexes i repetitives, o fins i tot pot millorar la precisió i la celeritat de diagnòstics mèdics, també obre múltiples controvèrsies i debats.

Cal que no oblidem, a més, que la IA no és neutral.

Ens la venen com a tal amb l’argument que allò basat en la ciència (números, fòrmules, …) és més eficaç o objectiu. Però això pot ser pervers: en “nom” dels números, es poden deixar de banda criteris ètics o de drets fonamentals.

Al cap i a la fi, assenyala Vicent Costa, el finançament de la recerca en IA és privat, i les principals creadores i comercialitzadores són Microsoft (empresa de la qual forma part OpenAI, desenvolupadora del ChatGTP entre d’altres), Google, Facebook i Amazon.

Aquestes mateixes empreses també ens parlen de la complexitat d’aquestes eines. Utilitzen terminologia complicada, parlen de grans volums de dades. Com si el coneixement de la IA estigués tancat en “caixes negres”…

I clar, allò que és molt complicat millor deixar-ho als experts. No val la pena mirar de comprendre-ho.

Doncs, de nou, resulta que no és tan difícil de comprendre, i que, entenent les bases d’aquesta tecnologia podem entendre molt millor els riscos i potencialitats. Anem a pams.

Què és la IA?

En primer lloc, aprofundim una mica en què parlem quan parlem d’Intel·ligència Artificial.

A l’informe Com s’informa sobre intel·ligència artificial? es fa un breu repàs de la seva definició.

La definició actual (no lliure de controvèrsia, com veurem més endavant) “s’aplica a qualsevol màquina que imita les funcions cognitives, com per exemple percebre, raonar, aprendre o resoldre problemes”.

La paraula, però, va ser encunyada el 1956 per John McCarthy, com “la ciència de fer màquines intel·ligents”.

Més tard, el 2004, ell mateix va fer evolucionar la definició, afegint que la IA “està relacionada amb la tasca d’utilitzar ordinadors per comprendre la intel·ligència humana”.

És tecnologia que funciona per algorismes, o el que és el mateix, conjunts d’operacions i instruccions, prèviament definides, destinades a executar tasques concretes: fer càlculs, resoldre problemes o prendre decisions.

Com una recepta de cuina, l’algoritme és el què li serveix a la IA per executar les accions. Però així com la recepta no pot fer-se sola, l’algorisme no és una acció sinó el conjunt de passos per a dur-la a terme. Així, la IA és tecnologia a la qual s’hi incorpora la recepta (l’algorisme) per tal que la segueixi de forma automàtica i repetida cada cop que hi introduïm uns “ingredients”.

A mesura que ha anat avançant la recerca i pràctica entorn la IA, s’ha anat complexitzant la combinació i creació d’aquests conjunts algorítmics. Arribant a l’actualitat al que s’anomenen “xarxes neuronals profundes”, que imiten el funcionament del nostre cervell.

Aquestes xarxes artificials funcionen de diferents maneres. Les podem classificar per tipus:

- la IA generativa: “crea” continguts (imatges, textos, …) a partir d’informació que se li ha introduït prèviament.

- la IA predictiva: front un estímul extern, aquesta tecnologia pot produir una resposta sense haver emmagatzemat dades o experiències prèvies. Un exemple serien els assistents de veu d’Apple o Google Siri i Alexa.

- la IA amb teoria de la ment: tot i no tenir-ne, sap com funcionen les intencions o desitjos humans, i podria interactuar-hi. Per exemple, canviar el comportament segons les circumstàncies que interpretaria en l’interlocutor/a.

- la IA autoreflexiva: una intel·ligència que realment pensi per si mateixa és el tipus que de moment només és una especulació… i la que pot semblar més perillosa.

I perquè siguin capaces de tot això, s’entrenen: per a fer-les més precises i “intel·ligents”, se les alimenta de grans volums de dades, relacionant conceptes i definicions, causa i efecte, etc.

A mesura que tenen més i més informació, que a priori (en el moment d’introducció de dades) no està connectada entre ella, aquestes xarxes poden arribar a extreure’n conclusions i respostes complexes.

La IA la trobem en moltes de les aplicacions tecnològiques que fem servir cada dia. En diagnòstics i intervencions mèdiques, als caixers automàtics, en els GPS, a les xarxes socials, a la publicitat personalitzada,… també a l’hora de demanar un préstec o una hipoteca a entitats bancàries, o en sol·licituds d’ajudes econòmiques, com beques o prestacions socials.

Però és intel·ligència? I és artificial?

“En realitat, el que avui anomenem Intel·ligència Artificial no és ni artificial ni intel·ligent”. Així de taxatiu es mostra l’autor d’aquest article, publicat originalment a The Guardian, el periodista, informàtic i filòsof Evgeny Morozov. Argumenta que els primers sistemes d’IA estaven regits per programes, i llavors estava justificat, com a mínim, “parlar d’artificialitat”.

Però que en l’actualitat:

- No és artificial perquè al darrere hi ha força de treball humana: ja sigui pels “artistes, músics, programadors i escriptors l’obra dels quals és expropiada” per a nodrir les bases de dades d’aquestes interfícies, com per totes aquelles treballadores que hi introdueixen dades. Feina, aquesta darrera, “molt precària, amb una gran presència de dones que entrenen aquests algorismes i en moderen els continguts”, com afirma en aquesta interessant entrevista Alex Haché, activista ciberfeminista integrant de Donestech.

- No és intel·ligència perquè ser intel·ligent no és només ser capaç d’identificar o reproduir patrons que coincideixen, sinó moltes altres coses que escapen a la racionalitat. Per exemple, generalitzar (agrupar idees, conceptes, objectes, records) a partir de les emocions. Cap màquina, diu Morozov, té sentit (més enllà del fet de conèixer-ho) “del passat, del present i del futur, de la història, del que fa mal, de la nostàlgia”. Llocs d’on parteixen les emocions. I si no hi ha emoció, no hi ha intel·ligència: és simple lògica formal.

Per això hi ha qui prefereix anomenar-la “sistemes de decisions automatitzades”. Entre aquests, Evgeny Morozov, que explica que si fem servir el terme “intel·ligència artificial” podem arribar a creure’ns que “el món funciona sota aquesta lògica formal”, racional i freda.

El filòsof Ariel Guersenzvaig, en la xerrada de presentació l’informe de Mediacat abans mencionat, diu que sovint, sota aquesta mirada deshumanitzadora “s’obliden les condicions dels treballadors darrere d’aquests sistemes: programadors, qui piquen dades o qui les mantenen”.

El també filòsof i matemàtic Vicent Costa (recomanem llegir l’entrevista que la Gemma Garcia li fa a la Directa número 567), especifica que la IA “pot simular” aspectes que considerem humans com la consciència, l’empatia, però tot és après, no sentit. “No en tindrà mai”, de capacitats genuïnament humanes.

Tot i que els models d’intel·ligència artificial no segueixin processos cognitius com els nostres, molts cops, els atribuïm aquestes capacitats. Segurament, molt influïdes per la ciència-ficció, que ens porta a mons on els robots tenen fins i tot ànima i desitjos profunds. I això ens fa por: serem substituïdes? O pitjor: conquerides i exterminades?

Per això és important la manera en com se’n parla, de la IA: “s’explica la IA com una caixa negra on no sabem què passa” afirma Ariel Guersenzvaig, i això dóna llocs a moltes interpretacions de com funciona i fins on pot arribar aquest tipus de tecnologia, així com pot “diluir les responsabilitats” dels impactes que pot arribar a tenir.

Drets i democràcia: els riscos de la IA

La IA es pot fer servir per manipular les nostres percepcions de la realitat, i modificar les nostres opinions… I això pot ser fatal per la democràcia.

Anem al pitjor: un moviment polític sense escrúpols podria fer servir la IA, d’una banda, per trobar les persones sensibles a cert tipus de missatges, i per l’altra, generant deepfakes: imatges i vídeos falsos que semblen reals, que donessin versemblança a aquests missatges.

Aquest tipus de riscos són els que s’expliquen en aquest interessant curtmetratge documental que imagina l’evolució de la IA i els seus efectes en la societat en els pròxims 10 anys.

Altres usos qüestionables d’aquest tipus de tecnologia són el militar i de vigilància. En són exemples les armes que no necessiten humans que les disparin, o el control a moltes ciutats mitjançant càmeres de reconeixement facial.

Aquest darrer tema, tot i que no en siguem conscients, ens toca de prop, perquè les ciutats (als carrers, a les botigues, …) estan cada cop més plenes de càmeres de vigilància.

Realment és molt fàcil obtenir informació sobre nosaltres sense que hi haguem donat permís. Com Maria Vanrell menciona, “anem regalant informació pel carrer”: les càmeres de vigilància saben com vestim, per on ens movem, la forma i trets identificatius del nostre cos, amb qui ens relacionem.

Aquests dispositius poden arribar a ser una eina brutal de control social, perquè poden reconèixer els nostres trets i atribuir-los a la nostra identitat.

A la Xina, per exemple, han ideat un sistema de disciplinament en base les conductes observables i adjudicables a cada ciutadà/na a través de les càmeres.

Però aquí no ens n’escapem: amb l’excusa de la “seguretat”, tenim cada cop més ulls posats en els nostres moviments, disposats a registrar cada passa, a fer-nos sentir que nosaltres o algú a prop nostre pot cometre un acte d’incivisme, o fins i tot un delicte en qualsevol moment.

No us sembla una manera de ficar-nos la por a dins? De fer-nos sentir encara més insegures? No us sona una mica a “El gran germà” del que parlava l’Orwell a 1984?

Però no només hi ha les càmeres per controlar-nos. És que a més, els bancs saben què, on i quan comprem, les apps de geolocalització saben per on ens movem, les xarxes socials se saben de memòria els nostres gustos i les nostres debilitats.

Capitalisme de dades… o com esprémer-nos al màxim

Només cal pensar en com actuen els algorismes: de sobte, al feed d’Instagram, o als resultats de Google comencen a aparèixer anuncis d’un mateix tipus de producte, o imatges de gent fent activitats molt específiques…

Missatges recurrents que poden arribar a fer-nos creure que realment tenir arrugues és un problema i necessitem aquella crema, o que cal anar a fer un taller de ceràmica caríssim.

És a dir, que modifiquen els nostres interessos, o arriben a crear-nos desitjos que abans no teníem.

Les sol·licituds d’hipoteques o ajudes socials també estan operades per tecnologia basada en intel·ligència artificial, amb totes les implicacions pel que fa a drets que pot tenir que aquests tipus de decisions siguin automatitzades i no responguin a criteris ètics.

També s’està aplicant tecnologia basada en intel·ligència artificial en sectors com els recursos humans, i està determinant les condicions laborals de moltes treballadores (per exemple utilitzen IA a plataformes de repartiment de menjar a domicili), a la vegada que crea nous llocs de treball precaris enfocats a entrenar i alimentar els algoritmes.

Un altre risc és la utilització d’IA en els processos de contractació, cosa que pot desembocar en la selecció d’aquells perfils “menys molestos” o que no generin pèrdues per l’empresari.

Us imagineu una IA que, creuant certs paràmetres (activitat a xarxes, llenguatge no verbal…), pugui detectar que una persona es vol sindicar o que té moltes probabilitats de tenir fills d’aquí poc i descartar-la per aquests motius?

Un altre risc afegit és com la IA entra a l’àmbit educatiu. Ens reservem aquest tema per expicar-vos-el més endavant… perquè mereix un article sencer!

Algorismes que reprodueixen biaixos racistes, masclistes i classistes

Els biaixos són comportaments o pràctiques discriminatoris que tenim integrats “per defecte”, i que manifestem quotidianament a l’hora de relacionar-nos: amb acudits, bromes, llocs a on anem i a on no volem anar, prejudicis, …

I és que a les societats occidentals potser ens creiem molt “progres”, però encara estem plenes de biaixos, fruit dels aprenentatges al llarg de la nostra vida. Aquests ens són molt difícils d’identificar, de saber d’on l’hem après exactament, i fins i tot d’erradicar, per molt que ens esforcem.

Per analogia, quan parlem de biaixos en la IA, ens referim a discriminacions que estan integrades en els mateixos sistemes, perquè els han après, fruit de l’entrenament que han rebut.

Com mencionàvem abans, els algorismes han canviat: ja no funcionen com abans, quan els biaixos eren identificables perquè s’introduïen a l’hora de crear o millorar-los. Ara es fan servir les xarxes neuronals profundes (deep learning): eines que s’entrenen a base de múltiples bases de dades, i és molt difícil identificar els biaixos en elles…

Per què? Per què funcionen com el cervell, de fet estan basades en el seu funcionament. Tenen capacitat d’aprendre si les entrenem. I aprenen de la informació que hi introduïm, i per tant aprenen de dades (i persones) que sí que en tenen, de biaix. Com nosaltres, vaja.

Recomanem llegir aquesta entrevista a la politòloga Virginia Eubanks, que ha investigat com la IA, sumada a tots els mecanismes burocràtics dels serveis socials o sanitaris pot perpetuar la pobresa, i de fet, als EUA és utilitzada per controlar les persones en situacions de vulnerabilitat.

L’organització Algorace, un col·lectiu multidisciplinari que treballa per contribuir a enriquir “el debat sobre l’impacte de l’ús de la IA en les poblacions racialitzades”, aprofundeix, en aquest informe, en el biaix racista dels algoritmes, posant exemples de discriminacions, i proposant estratègies per a fer-hi front.

I en la mateixa línia d’estudiar els biaixos, en aquest cas, de gènere, la col·lectiva Donestech ha compartit alguns articles que ens mostren com ni els avenços més contemporanis, com ho és la IA, escapen a la discriminació amb motiu de gènere.

La IA, contamina?

Una de les conseqüències de la IA que pot passar més desapercebuda per a l’usuari final, és el seu elevat cost mediambiental. “Entrenar” un ordinador pot arribar a emetre 284 tones de diòxid de carboni equivalent (CO2e), que és el que contaminen 47 persones en un any, o 5 vehicles al llarg de tota la seva vida útil (inclosa la seva fabricació).

A més, els centres de dades d’on prové tota la informació, el que coneixem com “el núvol”, consumeixen al voltant del 2% de l’energia global.

Però l’impacte comença molt abans. L’extracció de materials per a fabricar aquests sistemes, com el liti o el coltan, degrada el sòl, consumeix i contamina moltíssima aigua, contribueix al canvi climàtic i es fa a costa de l’explotació laboral de qui treballa a la mina, molt sovint, infants. Ho explicàvem en aquest article del nostre blog.

Resum: La IA, una tecnologia perillosament útil

Tornant al que comentàvem al principi: SI, la IA pot ser molt útil, i NO, no és una tecnologia innòcua.

A més, la Intel·ligència Artificial (com molts altres àmbits de desenvolupament tecnològic) avança més ràpid del temps que es necessita per mesurar-ne les conseqüències. Perquè aquestes conseqüències es manifesten en l’àmbit social, i escapen a tota previsió “tecnopositivista” (la mirada que s’enfoca en allò positiu dels avenços tecnològics, en les solucions que ens aporta a nivell productiu o econòmic).

I doncs, com podem detectar-ne els riscos? I que podem fer per evitar-los. El cert és que en l’àmbit individual podem fer poc, més enllà d’utilitzar aquestes eines amb consciència.

On cal actuar és en l’àmbit comunitari i institucional.

Per això, sorgeixen diverses institucions públiques i privades, o organitzacions que exigeixen regulacions que garanteixin que la recerca i l’ús de les aplicacions amb IA no posi en risc els drets fonamentals, no fomenti les desigualtats, o no generi impactes negatius en les vides humanes i no humanes (ja sigui en allò material com en allò immaterial: de socialització, psicològic o emocional).

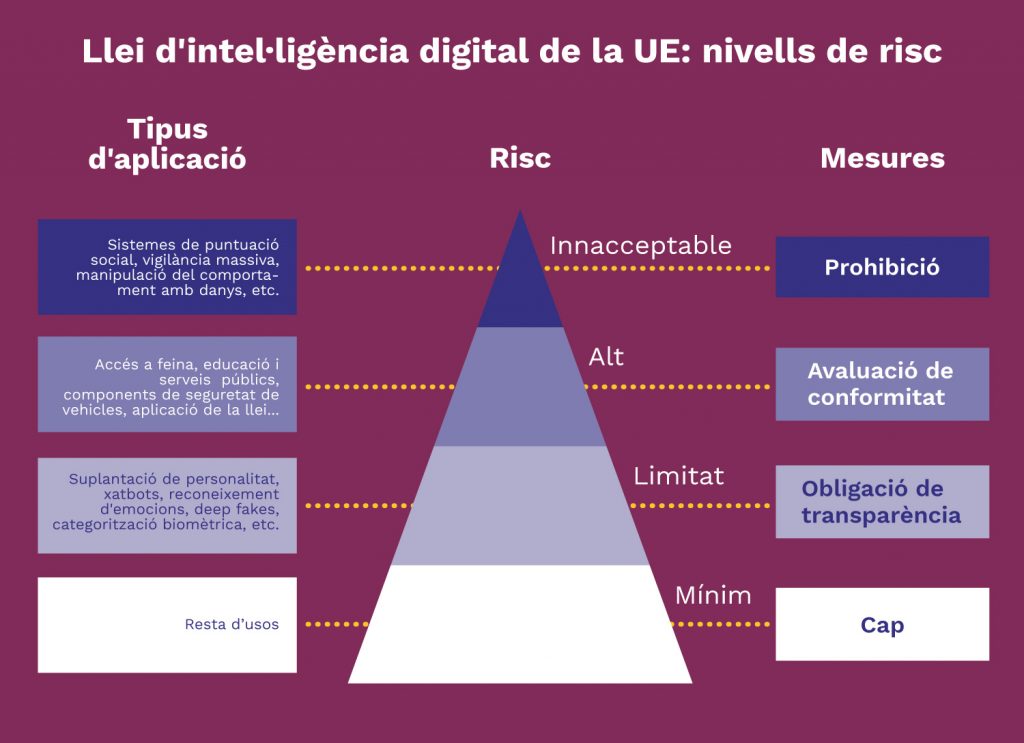

El 2021 s’aprovava la normativa de la Unió Europea. I no és l’única. Arreu del món s’han establert marcs reguladors per a prevenir els riscos i actuar sobre aquest fenomen que és la IA. L’objectiu d’aquesta llei és, segons el mateix text, garantir “la seguretat dels usuaris” tot i que això vagi en detriment de les empreses que semblen tenir pressa per a aplicar-la.

Si us interessa, en aquest enllaç trobareu l’anàlisi que en fa Marta Galceran, investigadora del CIDOB (Centre d’Informació i Documentació Internacionals a Barcelona), i com la compara amb diferents regulacions de la IA, que s’han anat constituint des del 2016 en diversos contextos territorials.

Vicent Costa opina que cal una moratòria per l’aplicació de certes tecnologies, i que per exemple, abans de la sortida al mercat de certs productes basats en la IA, s’haurien de provar i mesurar el seu possible impacte. Com un medicament, o una nova vacuna…

I és que la IA pot tenir solucions per alguns aspectes de les nostres vides, però potser cal revisar que realment ens és útil introduir-la indiscriminadament a tot allò que fem.

Com sempre, a Som Connexió hem proposat una mirada crítica.